| Type | |

|---|---|

| Inventeur |

Thomas Bayes |

| Date d'invention | |

| Nommé en référence à |

Thomas Bayes |

| Aspect de | |

| Formule |

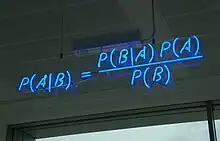

Le théorème de Bayes (/beɪz/ ) est l'un des principaux théorèmes de la théorie des probabilités. Il est aussi utilisé en statistiques du fait de son application, qui permet de déterminer la probabilité qu'un événement arrive à partir d'un autre évènement qui s'est réalisé, notamment quand ces deux évènements sont interdépendants.

En d'autres termes, à partir de ce théorème, il est possible de calculer précisément la probabilité d'un évènement en tenant compte à la fois des informations déjà connues et des données provenant de nouvelles observations. La formule de Bayes peut être dérivée des axiomes de base de la théorie des probabilités, en particulier de la probabilité conditionnelle. La particularité du théorème de Bayes est que son application pratique nécessite un grand nombre de calculs, c'est pourquoi les estimations bayésiennes n'ont commencé à être utilisées activement qu'après la révolution des technologies informatiques et de réseau.

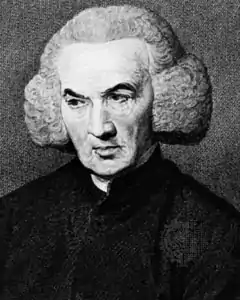

Sa formulation initiale est issue des travaux du révérend Thomas Bayes. Elle a été trouvée indépendamment par Pierre-Simon de Laplace. La formulation de Bayes en 1763 est plus limitée que les nouvelles formulations d'aujourd'hui.

Outre son utilisation en probabilité, ce théorème est fondamental pour l'inférence bayésienne qui s'est montrée très utile en intelligence artificielle. Il est également utilisé dans plusieurs autres domaines : en médecine, en sciences numériques, en géographie, en démographie, etc.

Pour le mathématicien Harold Jeffreys, les formulations de Bayes et de Laplace sont des axiomes et considère également que « le théorème de Bayes est à la théorie des probabilités ce que le théorème de Pythagore est à la géométrie. »[1]

Histoire

À sa mort en , Thomas Bayes laisse à Richard Price ses articles non terminés. C'est ce dernier qui prend l'initiative de publier l'article « An Essay towards solving a Problem in the Doctrine of Chance » et de l'envoyer à la Royal Society deux ans plus tard[2].

D'après Martyn Hooper, il est probable que Richard Price ait lui-même contribué de manière significative à la rédaction de l'article final et qu'il soit ainsi avec Thomas Bayes l'auteur du théorème connu sous le nom de théorème de Bayes. Cette erreur d'attribution serait une application de la loi d'éponymie de Stigler selon laquelle les découvertes scientifiques sont rarement attribuées à leur premier auteur[2],[3].

La formule est redécouverte par Pierre-Simon de Laplace en 1774[4].

Dans son unique article, Bayes cherchait à déterminer ce que l’on appellerait actuellement la distribution a posteriori de la probabilité p d’une loi binomiale. Ses travaux ont été édités et présentés à titre posthume (1763) par son ami Richard Price dans Un essai pour résoudre un problème dans la théorie des risques (An Essay towards solving a Problem in the Doctrine of Chances). Les résultats de Bayes ont été étendus dans un essai de 1774 par le mathématicien français Laplace, lequel n’était apparemment pas au fait du travail de Bayes[5]. Le résultat principal obtenu par Bayes est le suivant : en considérant une distribution uniforme du paramètre binomial p et une observation O d'une loi binomiale , où m est donc le nombre d’issues positives observées et n le nombre d’échecs observés, la probabilité que p soit entre a et b sachant O vaut :

Ces résultats préliminaires impliquent le résultat que l’on appelle théorème de Bayes, mais il ne semble pas que Bayes se soit concentré ou ait insisté sur ce résultat.

Ce qui est « bayésien » (au sens actuel du mot) dans ce résultat, c’est que Bayes ait présenté cela comme une probabilité sur le paramètre p. Cela revient à dire qu’on peut déterminer non seulement des probabilités à partir d’observations issues d’une expérience, mais aussi les paramètres relatifs à ces probabilités. C’est le même type de calcul analytique qui permet de déterminer par inférence les deux. En revanche, si l’on s'en tient à une interprétation fréquentiste (en), on est censé ne pas considérer de probabilité de distribution du paramètre p et en conséquence, on ne peut raisonner sur p qu’avec un raisonnement d’inférence (logique) non-probabiliste.

Depuis l'an 2000, les publications à son sujet se multiplient en raison de ses nombreuses applications[4].

Énoncé

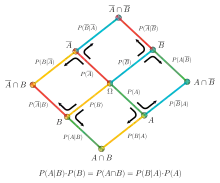

Le théorème de Bayes est un corollaire du théorème de probabilité totale. Il énonce des probabilités conditionnelles de plusieurs évènements. Par exemple, pour les évènements A et B, il permet de déterminer la probabilité de A sachant B, à partir des probabilités de A , de B et de B sachant A, à condition que la probabilité de B ne soit pas égale à 0.

Dans sa formulation de 1763[6],[7], le théorème était énoncé[8] :

, à condition que [8],[9],[10], et où[8] :

- et sont deux évènements ;

- et sont la probabilité des deux évènements ;

- est la probabilité conditionnelle que l'évènement A se réalise étant donné que l'évènement B s'est réalisé.

- est la probabilité conditionnelle que l'évènement B se réalise étant donné que l'évènement A s'est réalisé.

Il peut également s'écrire :

- et sont les probabilités a priori de et de ;

- est la probabilité conditionnelle de sachant ou probabilité a posteriori ;

- est la probabilité conditionnelle de sachant ou probabilité a posteriori.

Autres formulations intégrant la fonction de vraisemblance

Le théorème est également reformulé afin d'intégrer la fonction de vraisemblance marginale (en) (fonction de vraisemblance intégrant la constante de normalisation (en)). Il se formule ainsi :

Dans un univers , les partitions d'un ensemble (c'est-à-dire et ), la probabilité conditionnelle des évènements mutuellement exclusifs et exhaustifs (), à condition que , en sachant se calcule :

, où :

- et sont les probabilités a priori de et de ;

- est la probabilité conditionnelle de sachant ou probabilité a posteriori ;

- est la probabilité conditionnelle de sachant ou probabilité a posteriori.

Le calcul de dépend de son champ d'application. En sciences numériques, elle est nommée « preuve » pour désigner la fonction de vraisemblance marginale[12] et appliquée en médecine, elle désigne un rapport de vraisemblance[13].

Il peut également s'écrire :

et :

, où :

- est le complémentaire de . Plus généralement, si est un système quasi complet d'évènements fini ou dénombrable,

- , pour tout évènement du système .

Explications

Pour aboutir au théorème de Bayes, on part d’une des définitions de la probabilité conditionnelle :

Cette formulation ne fait que traduire en langage mathématique des remarques relativement triviales :

- La probabilité d'avoir observé les évènements A et B, en supposant par exemple que A arrive le premier, c'est la probabilité d'avoir l'évènement A, c'est-à-dire P(A), puis d'observer B lorsque A est présent, qui a alors (par définition) la probabilité P(B|A) .

- La valeur de la probabilité d'ensemble est donc le produit des deux probabilités de base : .

- Mais comme il est indifférent, pour observer A et B, de savoir dans quel ordre ils sont apparus, on a évidemment

En divisant de part et d’autre par P(B), on obtient :

soit le théorème de Bayes.

Exemples

De quelle urne vient la boule ?

À titre d’exemple, imaginons deux urnes remplies de boules. La première contient dix (10) boules noires et trente (30) blanches ; la seconde en a vingt (20) de chaque. On tire sans préférence particulière une des urnes au hasard et dans cette urne, on tire une boule au hasard. La boule est blanche. Quelle est la probabilité qu'on ait tiré cette boule dans la première urne sachant qu'elle est blanche ?

Intuitivement, on comprend bien qu'il est plus probable que cette boule provienne de la première urne, que de la seconde. Donc, cette probabilité devrait être supérieure à 50 %. La réponse exacte (60 %) peut se calculer à partir du théorème de Bayes.

Soit H1 l’hypothèse « On tire dans la première urne. » et H2 l’hypothèse « On tire dans la seconde urne. ». Comme on tire sans préférence particulière, P(H1) = P(H2) ; de plus, comme on a certainement tiré dans une des deux urnes, la somme des deux probabilités vaut 1 : chacune vaut 50 %.

Notons D l’information donnée « On tire une boule blanche. » Comme on tire une boule au hasard dans une des urnes, la probabilité de D sachant l'hypothèse H1 réalisée vaut :

De même la probabilité de D sachant l'hypothèse H2 réalisée vaut :

La formule de Bayes dans le cas discret nous donne donc :

Avec :

Avant que l’on regarde la couleur de la boule, la probabilité d’avoir choisi la première urne est une probabilité a priori, P(H1) soit 50 %. Après avoir regardé la boule, on révise notre jugement et on considère P(H1|D), soit 60 %, ce qui confirme notre intuition première.

Applications

Ce théorème élémentaire (originellement nommé « de probabilité des causes ») a des applications considérables.

Le théorème de Bayes est utilisé dans l’inférence statistique pour mettre à jour ou actualiser les estimations d’une probabilité ou d’un paramètre quelconque, à partir des observations et des lois de probabilité de ces observations. Il y a une version discrète et une version continue du théorème.

- L’école bayésienne utilise les probabilités comme moyen de traduire numériquement un degré de connaissance (la théorie mathématique des probabilités n’oblige en effet nullement à associer celles-ci à des fréquences, qui n’en représentent qu’une application particulière résultant de la loi des grands nombres). Dans cette optique, le théorème de Bayes peut s’appliquer à toute proposition, quelle que soit la nature des variables et indépendamment de toute considération ontologique.

- L’école fréquentiste utilise les propriétés de long terme de la loi des observations et ne considère pas de loi sur les paramètres, inconnus mais fixés.

Inférence bayésienne

Les règles de la théorie mathématique des probabilités s’appliquent à des probabilités en tant que telles, pas uniquement à leur application en tant que fréquences relatives d’évènements aléatoires (voir Événement (probabilités)). On peut décider de les appliquer à des degrés de croyance en certaines propositions. Ces degrés de croyance s’affinent au regard d’expériences en appliquant le théorème de Bayes.

Le Théorème de Cox-Jaynes justifie aujourd’hui très bien cette approche, qui n’eut longtemps que des fondements intuitifs et empiriques.

Réseaux bayésiens

Dans The Book of Why, Judea Pearl présente la règle de Bayes comme un cas particulier d'un réseau bayésien à deux nœuds et un lien. Les réseaux bayésiens constituent une extension de la règle de Bayes à des réseaux de plus grande taille[14].

Problème de Monty Hall

Filtres bayésiens

Critiques

Aspects sociaux, juridiques et politiques

Un problème régulièrement soulevé par l’approche bayésienne est le suivant : si une probabilité de comportement (délinquance, par exemple) est fortement dépendante de certains facteurs sociaux, culturels ou héréditaires, alors :

- d’un côté, on peut se demander si cela ne suppose pas une partielle réduction de responsabilité, morale à défaut de juridique, des délinquants. Ou, ce qui revient au même, à une augmentation de responsabilité de la société, qui n’a pas su ou pas pu neutraliser ces facteurs, comme elle aurait peut-être dû le faire.

- d’un autre côté, on peut souhaiter utiliser cette information pour orienter au mieux une politique de prévention, et il faut voir si l’intérêt public ou la morale s’accommoderont de cette discrimination de facto des citoyens (fût-elle positive).

Les statistiques ont été évoquées à plusieurs reprises dans les tribunaux[15] et dans certains cas impliquées dans des erreurs judiciaires importantes, comme les cas de Sally Clark ou de Lucia de Berk[16]. La formule de Bayes a été soit méconnue soit mal utilisée. Ainsi l'accusation estimait faible voire quasi nulle la probabilité pour un innocent d'être reconnu coupable en de tels cas. Ce n'est qu'après la sentence que des experts protestèrent et démontrèrent que cette probabilité prise en considération n'avait pas de sens et qu'il fallait au contraire étudier celles d'être coupable ou innocent sachant qu'il y a eu décès (ce qui donne des chiffres largement différents laissant place à un doute légitime). Pudiquement, on désigne par sophisme du procureur ces confusions entre probabilités conditionnelles.

« Faux positifs » médicaux

Les faux positifs sont une difficulté inhérente à tous les tests : aucun test n’est parfait. Parfois, le résultat sera positif à tort, ce que l’on nomme parfois risque du premier ordre ou risque alpha.

Par exemple, quand on teste une personne pour savoir si elle est infectée par une maladie, il y a un risque, généralement infime, que le résultat soit positif, alors que le patient n’a pas contracté la maladie. Le problème alors n’est pas de mesurer ce risque dans l’absolu (avant de procéder au test), il faut encore déterminer la probabilité qu’un test positif le soit à tort. Nous allons montrer comment, dans le cas d’une maladie très rare, le même test, par ailleurs très fiable, peut aboutir à une nette majorité de positifs illégitimes.

Voici un exemple qui illustre ce phénomène, imaginons un test extrêmement fiable :

- si un patient a contracté la maladie, le test le fait remarquer, c’est-à-dire est positif, presque systématiquement, 99 % des fois, soit avec une probabilité 0,99 ;

- si un patient est sain, le test est correct, c’est-à-dire négatif dans 95 % des cas, soit avec une probabilité 0,95.

Imaginons que la maladie ne touche qu’une personne sur mille, soit avec une probabilité 0,001. Cela peut paraître peu, mais dans le cas d’une maladie mortelle, c’est considérable. Nous avons toutes les informations nécessaires pour déterminer la probabilité qu’un test soit positif à tort, ce qui peut causer un surdiagnostic.

Désignons par A l’événement « Le patient a contracté la maladie » et par B l’événement « Le test est positif ». La seconde forme du théorème de Bayes dans le cas discret donne alors :

Avec :

- = la probabilité que le patient soit malade sachant que le test est positif

- = la probabilité que le test soit positif sachant que la patient est malade

- = la probabilité à priori que le patient soit malade

- = la probabilité à priori que le test soit positif = , c'est-à-dire le cas où le patient est détecté positif alors qu'il est réellement malade (vrai positif) ainsi que le cas où le patient est détecté positif alors qu'il est sains (faux positif).

Traduit en langage courant, cette équation signifie que « la probabilité que le patient ait réellement contracté la maladie, quand le test est positif, n'est que de 1,9 % ».

Sachant que le test est positif, la probabilité que le patient soit sain vaut donc environ :

(1 − 0,019) = 0,981. Du fait du très petit nombre de malades, en effet,

- pratiquement tous les malades présentent un test positif, mais aussi

- pratiquement tous les tests positifs désignent des personnes saines.

Si le traitement est très lourd, coûteux ou dangereux pour un patient sain, il peut être alors opportun de faire subir, à tous les patients positifs, un test complémentaire (qui sera sans doute plus précis et plus coûteux, le premier test n’ayant servi qu’à écarter les cas les plus évidents).

On a tout de même réussi, avec le premier test, à isoler une population vingt fois moindre, qui contient pratiquement tous les malades. En effet, en enlevant les patients dont le test est négatif et qui sont donc supposés sains, on a ramené le rapport des malades sur la population étudiée d'un individu sur mille à un individu sur cinquante (P(A|B) est proche de 1/50). En procédant à d’autres tests, on peut espérer améliorer la fiabilité de la détection.

Le théorème de Bayes nous montre que dans le cas d’une probabilité faible de la maladie recherchée, le risque d’être déclaré positif à tort a un impact très fort sur la fiabilité. Le dépistage d'une maladie rare peut causer le surdiagnostic.

Cette erreur intuitive, commune, d'estimation est un biais cognitif appelé "oubli de la fréquence de base".

Notes et références

Notes

- (pt)/(it) Cet article est partiellement ou en totalité issu des articles intitulés en portugais « Teorema_de_Bayes » (voir la liste des auteurs) et en italien « Teorema_di_Bayes » (voir la liste des auteurs).

Références

- ↑ Harold Jeffreys, Scientific Inference, Cambridge University Press, (ISBN 978-0-521-18078-8), p. 31

- 1 2 (en) Martyn Hooper, « Richard Price, Bayes'theorem, and God », Significance, vol. 10, no 1, (DOI 10.1111/j.1740-9713.2013.00638.x, lire en ligne)

- ↑ (en) Christian Robert, « Price's theorem », sur xianblog (Blog de Christian Robert), (consulté le )

- 1 2 « Une formule mathématique universelle existe-t-elle ? », France Culture, (lire en ligne, consulté le )

- ↑ coordonné par E. Barbin & J.-P. Lamarche, Histoires de probabilités et de statistiques : [colloque, Orléans, 31 mai et 1er juin 2002], Paris, Ellipses, , 296 p. (ISBN 2-7298-1923-1), p. 204

- ↑ Habibzadeh F, Habibzadeh P. The likelihood ratio and its graphical representation. Biochem Med (Zagreb). 2019;29(2):020101. doi:10.11613/BM.2019.020101

- ↑ A. Stuart et K. Ord, Kendall's Advanced Theory of Statistics: Volume I—Distribution Theory, Edward Arnold, , §8.7

- 1 2 3 (en) Newman TB et Kohn MA, « Evidence-Based Diagnosis », Cambridge University Press, New York, (DOI 10.1017/CBO9780511759512, lire en ligne)

- 1 2 (en) A. Stuart et K. Ord, Kendall's Advanced Theory of Statistics: Volume I—Distribution Theory, Edward Arnold, .

- 1 2 Bussab et Morettin 2010, p. 116.

- ↑ Bussab et Morettin 2010, p. 111.

- ↑ (en) Charles S. Bos, « A Comparison of Marginal Likelihood Computation Methods », Tinbergen Institute Working Paper, nos 2002-084/4, (DOI 10.2139/ssrn.332860, lire en ligne)

- ↑ (en) Judea Pearl; Dana Mackenzie, The Book of Why : The New Science of Cause and Effect, New York, Penguin, , 432 p. (ISBN 978-0-14-198241-0), Suppose a forty-year-old woman gets a mammogram to check for breast cancer, and it comes back positive. The hypothesis, D (for “disease”), is that she has cancer. The evidence, T (for “test”), is the result of the mammogram. How strongly should she believe the hypothesis? Should she have surgery?We can answer these questions by rewriting Bayes’s rule as follows:(Updated probability of D) = P(D|T) = (likelihood ratio) × (prior probability of D) (3.2)where the new term “likelihood ratio” is given by P(T|D)/P(T). It measures how much more likely the positive test is in people with the disease than in the general population.

- ↑ (en) Judea Pearl, The Book of Why : The New Science of Cause and Effect, Penguin Books, , 432 p. (ISBN 978-0-14-198241-0 et 0141982411), p. 112-113.

- ↑ (en) Legal cases involving Bayes

- ↑ (en) Bayes and the Law 27 janvier 2015

Voir aussi

Bibliographie

- (en) T. Bayes (1763), « An Essay towards solving a Problem in the Doctrine of Chances », Philosophical Transactions of the Royal Society of London, 53:370-418.

- (en) T. Bayes (1763/1958) « Studies in the History of Probability and Statistics: IX. Thomas Bayes’s Essay Towards Solving a Problem in the Doctrine of Chances », Biometrika 45:296-315 (Bayes’s essay in modernized notation)

- (en) T. Bayes « « An essay towards solving a Problem in the Doctrine of Chances » » (version du 26 janvier 2019 sur Internet Archive) (Bayes's essay in the original notation)

- (en) Richard Price, « A demonstration of the second rule in the essay towards the solution of a problem in the doctrines of chances », Philosophical Transactions, vol. 54, , p. 296-325

- (fr) P.S. Laplace (1774) « Mémoire sur la Probabilité des Causes par les Événements, » Savants Étranges 6:621-656, ou bien Œuvres complètes 8:27-65.

- (en) G.A. Barnard. (1958) « Studies in the History of Probability and Statistics: IX. Thomas Bayes's Essay Towards Solving a Problem in the Doctrine of Chances », Biometrika 45:293-295 (biographical remarks)

- (en) S.M. Stigler (1982) « Thomas Bayes' Bayesian Inference, » Journal of the Royal Statistical Society, Series A, 145:250-258 (Stigler argues for a revised interpretation of the essay -- recommended)

- (en) A. Papoulis (1984), Probability, Random Variables, and Stochastic Processes, second edition. New York: McGraw-Hill.

- (en) S.M. Stigler (1986), « Laplace's 1774 memoir on inverse probability, » Statistical Science, 1(3):359--378.

- (en) S.E. Fienberg (2005) When did Bayesian Inference become "Bayesian"? Bayesian Analysis, p. 1-40

- (en) Sharon Bertsch McGrayne, The Theory That Would Not Die : How Bayes' Rule Cracked the Enigma Code, Hunted Down Russian Submarines, and Emerged Triumphant from Two Centuries of Controversy, Yale University Press,

- (en) Jeff Miller Earliest Known Uses of Some of the Words of Mathematics (B) (very informative -- recommended)

- (en) D. Covarrubias « An Essay Towards Solving a Problem in the Doctrine of Chances »(Archive.org • Wikiwix • Archive.is • Google • Que faire ?) (an outline and exposition of Bayes's essay)

- (en) Bradley Efron, « Bayes' Theorem in the 21st Century », Science, vol. 340, no 6137, , p. 1177-1178 (DOI 10.1126/science.1236536)

- Myron Tribus, Rational Descriptions, Decisions and Designs. Chapter 3 The Bayes Equation, Pergamon 1969 (traduction française : Décisions rationnelles dans l'incertain, chapitre 3 : Équation de Bayes et déductions rationnelles, Masson, 1972)

- Lê Nguyên Hoang, La formule du savoir : une philosophie unifiée fondée sur le théorème de Bayes, EDP Sciences, 2018. 402 p. (ISBN 978-2-7598-2260-7).

- (pt) Wilton de O. Bussab et Pedro A. Morettin, Estatística Básica, São Paulo, Saraiva, , 540 p.

Articles connexes

- Probabilité conditionnelle

- Statistique bayésienne

- Inférence bayésienne

- Fonction de vraisemblance

- Tableau de contingence

- Paradoxe de Hempel dit de l'ornithologie en chambre

- Rasoir d'Occam ou Argument (épistémologique) de parcimonie,

- Réseau bayésien

- Estimateur de Laplace–Bayes

- Bayésianisme

Liens externes

Émission de radio

- Une formule mathématique universelle existe-t-elle ?, France Culture, Science publique,

.jpg.webp)